Одним из самых эффективных алгоритмов сжатия данных является алгоритм Хаффмана, разработанный американским ученым Дэвидом Хаффманом. Он основан на идее переменной длины кодирования символов в зависимости от частоты их встречаемости в исходном тексте.

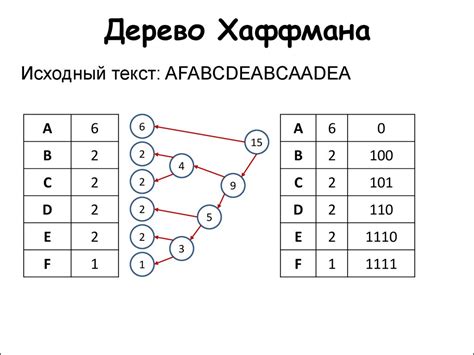

Принцип работы алгоритма Хаффмана состоит из нескольких этапов. Сначала происходит подсчет частоты встречаемости каждого символа в исходном тексте. Затем строится двоичное дерево, в котором листья соответствуют символам, а каждая внутренняя вершина является суммой частот своих потомков.

Далее происходит кодирование символов. Для каждого символа определяется его битовое представление, составленное из нулей и единиц. При этом более часто встречающимся символам присваиваются коды вида 0, 00, 000 и так далее, а менее часто встречающимся символам - коды вида 1, 01, 001 и т.д. Кодирование выполняется путем спуска по дереву от корня к листу, где находится символ, который нужно закодировать.

Преимущество алгоритма Хаффмана заключается в том, что он позволяет достичь высокой степени сжатия данных без потери информации. Этот алгоритм широко применяется в сжатии текстовых файлов, а также в сетевых протоколах передачи данных. Например, в сжатии файла размером 1 МБ можно достичь сжатия до 200-300 КБ при использовании алгоритма Хаффмана.

Принцип работы алгоритма Хаффмана

Процесс работы алгоритма Хаффмана состоит из нескольких этапов:

- Сбор информации о частоте повторения символов: алгоритм проходит по всем данным и подсчитывает частоту повторения каждого символа.

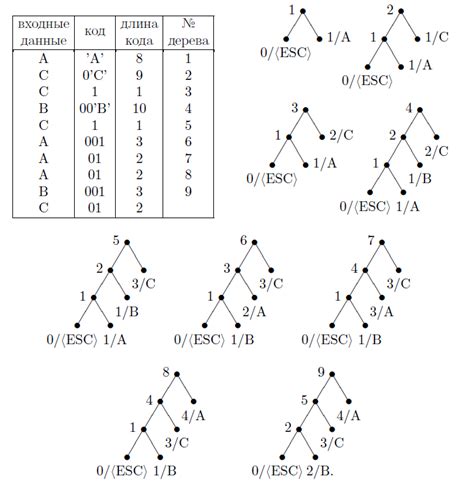

- Создание дерева Хаффмана: символы сортируются по частоте повторений, после чего строится бинарное дерево Хаффмана. Вершины дерева представляют собой сумму двух наименее часто встречающихся символов.

- Кодирование символов: при обходе дерева снизу вверх каждому символу присваивается уникальный код, при этом левую ветвь обозначают 0, а правую 1.

- Создание таблицы кодов: алгоритм создает таблицу, где каждому символу соответствует его кодированное представление.

- Сжатие данных: исходные данные заменяются соответствующими кодами из таблицы и объединяются в один битовый поток.

Пример кодирования:

- Пусть у нас есть набор символов: A, B, C, D, E.

- Частота повторения символа A - 5, B - 3, C - 2, D - 2, E - 1.

- Строим дерево Хаффмана:

- Создаем листы для каждого символа и их частоты повторения.

- Сортируем листы по частоте повторений.

- Берем два наименьших листа и объединяем их в один узел.

- Повторяем предыдущий шаг до тех пор, пока не получим один корневой узел.

- Получаем дерево:

* / \ * E / \ * D / \ C B / \ A

- A - 10, B - 01, C - 000, D - 001, E - 11.

- A - 10, B - 01, C - 000, D - 001, E - 11.

Алгоритм Хаффмана позволяет эффективно сжимать данные, особенно те, в которых некоторые символы встречаются чаще других. Он широко применяется в компьютерных сетях, сжатии видео и аудио файлов, а также в других областях, где важно экономить ресурсы и объем передаваемых данных.

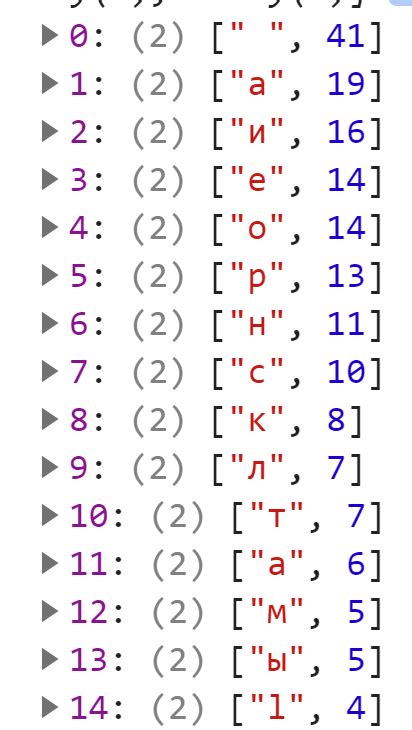

Анализ частоты символов

Для проведения анализа можно использовать различные методы. Один из них - подсчет частоты каждого символа в тексте. Для этого можно использовать счетчик, который будет увеличивать значение для каждого встреченного символа. Таким образом, мы получим информацию о количестве появлений каждого символа в тексте.

После анализа мы можем представить результаты в виде таблицы, в которой указаны символы и их частоты. Это позволяет нам увидеть, какие символы встречаются чаще всего, а какие реже всего.

Анализ частоты символов является важной частью алгоритма Хаффмана, так как именно на основе этой информации будет создано дерево Хаффмана, которое будет использоваться для кодирования и декодирования текста.

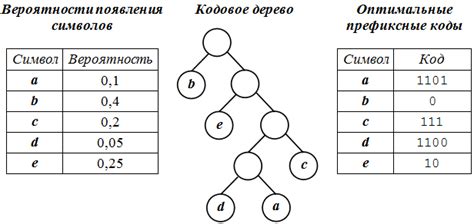

Построение двоичного дерева Хаффмана

Процесс построения двоичного дерева Хаффмана включает следующие этапы:

1. Создание листьев дерева: Каждый символ из исходного набора символов рассматривается как отдельный лист дерева с частотой его встречаемости в исходных данных.

2. Объединение листьев: Два листа с наименьшими частотами объединяются в один узел, который становится родительским узлом для этих листьев. Частота родительского узла равна сумме частот его потомков.

3. Повторение объединения: Этот процесс повторяется до тех пор, пока все листья не объединятся в одно дерево.

4. Присвоение кодов: После построения дерева каждому символу присваивается уникальный код, который определяется путем спуска от корня дерева к соответствующему символу. Ветвление влево и вправо в дереве используется для обозначения битов "0" и "1" соответственно.

Пример построения двоичного дерева Хаффмана:

Пусть исходный набор символов состоит из 4 символов: "A", "B", "C" и "D", с их соответствующими частотами: 2, 3, 4 и 5.

Шаг 1: Создание листьев дерева:

(A:2) (B:3) (C:4) (D:5)

Шаг 2: Объединение листьев:

(A:2 + B:3) (C:4) (D:5) |____________________|

Шаг 3: Объединение листьев:

(A:2 + B:3 + C:4) (D:5) |___________|

Шаг 4: Объединение листьев:

(A:2 + B:3 + C:4 + D:5) |_________|

Шаг 5: Присвоение кодов:

(A:2 + B:3 + C:4 + D:5) / | \ 0 10 11

Таким образом, получено двоичное дерево Хаффмана, в котором каждому символу присвоен уникальный код. Это дерево используется для сжатия и распаковки данных в алгоритме Хаффмана.

Создание кодовых таблиц

Для создания кодовых таблиц необходимо выполнить следующие шаги:

- Построить дерево Хаффмана, как описано в предыдущем разделе. В каждом узле дерева записать букву или значение, соответствующее коду символа. В левом потомке узла записывается значение 0, в правом потомке - значение 1.

- Построить таблицу, в которой каждому символу сопоставляется его кодовое представление. Для этого нужно пройти все символы алфавита, начиная с наименее частого, и записывать путь от корня дерева Хаффмана до символа.

Пример кодовой таблицы:

| Символ | Код |

|---|---|

| A | 00 |

| B | 01 |

| C | 10 |

| D | 11 |

Таким образом, символу "A" соответствует код "00", символу "B" - код "01", символу "C" - код "10", символу "D" - код "11".

Кодовые таблицы позволяют эффективно сжимать данные с использованием алгоритма Хаффмана, заменяя длинные последовательности символов на более короткие коды. Это позволяет сократить объем передаваемой или хранимой информации и ускорить обработку данных.

Примеры кодирования методом Хаффмана

Приведем несколько примеров кодирования текстовых сообщений при помощи алгоритма Хаффмана:

1. Рассмотрим сообщение "HELLO WORLD".

Шаг 1: Создадим таблицу вероятностей появления каждого символа:

Символ | Частота

H | 1

E | 1

L | 3

O | 2

W | 1

R | 1

D | 1

Шаг 2: Построим двоичное дерево, объединяя две наименее вероятные буквы и суммируя их частоты:

(10)

/ \

(5) (5)

/ \ / \

(2) (3) (3) (2)

E (2) (1) (W)

/ \

(1) (1)

H O

Шаг 3: Присвоим нули левым детям и единицы правым детям, двигаясь по дереву от корня:

E - 0

H - 100

O - 101

W - 110

R - 1110

D - 1111

L - 111

Шаг 4: Закодируем исходное сообщение, заменяя каждую букву ее кодом:

HELLO WORLD = 10010110110111101110111000101110

2. Рассмотрим сообщение "ABRACADABRA".

Шаг 1: Создадим таблицу вероятностей появления каждого символа:

Символ | Частота

A | 5

B | 2

C | 1

D | 1

R | 2

Шаг 2: Построим двоичное дерево, объединяя две наименее вероятные буквы и суммируя их частоты:

(11)

/ \

(5) (6)

/ \ / \

(2) (3) (4) (2)

(B) (A) (R) (3)

/ \

(1) (2)

C D

Шаг 3: Присвоим нули левым детям и единицы правым детям, двигаясь по дереву от корня:

B - 0

A - 10

R - 11

C - 100

D - 101

Шаг 4: Закодируем исходное сообщение, заменяя каждую букву ее кодом:

ABRACADABRA = 1011101001000101110101101000