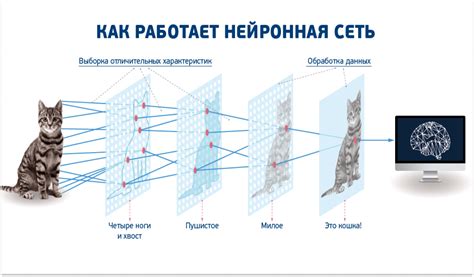

Нейронные сети являются одной из самых востребованных и перспективных технологий в области машинного обучения. Они успешно применяются в различных областях, таких как компьютерное зрение, распознавание речи, обработка естественного языка и многих других. Однако, разработка и обучение эффективных нейронных сетей требует значительных ресурсов, как временных, так и вычислительных.

Оптимизация нейронных сетей является важной задачей для повышения их эффективности и производительности. Один из подходов к оптимизации состоит в использовании предтренировки моделей. Предтренировка моделей представляет собой процесс обучения нейронной сети на большом количестве данных искусственно созданных с помощью различных методов.

В результате предтренировки моделей, нейронная сеть обучается на широком наборе данных, а значит, способна изучить множество признаков и закономерностей, что позволяет ей эффективно решать широкий спектр задач. Затем, предтренированная модель может быть дообучена на узкой задаче с помощью меньшего количества данных, что существенно экономит ресурсы и улучшает производительность.

Принципы предтренировки моделей

Существуют различные принципы предтренировки моделей, включая:

- Автоэнкодеры: Это нейронные сети, которые обучаются кодировать входные данные в скрытое представление и затем восстанавливать исходные данные из этого представления. Автоэнкодеры могут быть использованы для извлечения важных признаков из данных.

- Глубокие болты: Они используются для предобработки данных, позволяя модели выучить иерархические признаки. Глубокие болты могут быть обучены поэтапно, начиная от первого скрытого слоя и добавляя последовательно новые слои.

- Перенос обучения: Этот принцип предполагает использование предтренированных моделей на некоторой задаче для обучения моделей на других задачах. Предтренированные модели уже имеют представление о многих общих признаках данных, что ускоряет процесс обучения на новой задаче.

- Генеративные модели: Они используются для генерации новых данных на основе существующих. Предтренировка генеративных моделей может быть полезной для повышения способности модели к обобщению и генерации новых вариаций данных.

Выбор принципа предтренировки моделей зависит от конкретной задачи и доступных данных. Оптимальный выбор принципа позволяет достичь лучших результатов в обучении моделей и повысить их эффективность в решении конкретных задач машинного обучения.

Оптимизация нейронных сетей

В процессе оптимизации нейронных сетей используются различные методы и алгоритмы, которые позволяют настраивать параметры модели таким образом, чтобы минимизировать ошибку на тренировочных данных и достичь лучших результатов на тестовой выборке. Оптимизация включает в себя выбор оптимальных коэффициентов обучения, функции активации, архитектуры модели и многие другие аспекты.

Одним из ключевых принципов предтренировки моделей является использование предобученных моделей, которые обучены на больших наборах данных. Предобученные модели имеют уже настроенные веса, что позволяет значительно сократить время обучения и снизить вероятность переобучения модели. Это особенно полезно, когда у нас есть ограниченное количество данных или ограниченные ресурсы для обучения модели.

Другим важным принципом оптимизации нейронных сетей является выбор правильной функции потерь. Функция потерь определяет, насколько хорошо модель соответствует ожидаемым выходным данным. Различные функции потерь подходят для разных задач, поэтому выбор правильной функции потерь может значительно повлиять на производительность модели.

Также важно учитывать регуляризацию и нормализацию во время оптимизации нейронных сетей. Регуляризация помогает предотвратить переобучение модели путем добавления штрафов за сложность модели или ограничения на веса. Нормализация данных позволяет улучшить стабильность обучения и скорость сходимости.

Кроме того, оптимизация нейронных сетей включает в себя техники оптимизации гиперпараметров, таких как выбор оптимального числа слоев и нейронов, а также выбор оптимальных алгоритмов оптимизации, таких как градиентный спуск или стохастический градиентный спуск.

В целом, оптимизация нейронных сетей является сложной задачей, которая требует глубоких знаний в области машинного обучения и опыта в работе с нейронными сетями. Но правильная оптимизация моделей позволяет достичь более точных результатов и повысить эффективность работы в различных приложениях машинного обучения.

Преимущества использования предтренированных моделей

- Экономия времени и ресурсов: Предварительное обучение моделей на больших наборах данных, часто требующих значительного времени и вычислительных ресурсов, позволяет существенно сократить время и затраты при обучении новой модели. Зачастую предтренированная модель может быть доопределена на относительно небольшом наборе данных, что позволяет сэкономить время и средства при разработке решений в областях с ограниченными ресурсами.

- Захват доменных знаний: В предтренированных моделях уже закодированы общие характеристики и доменные знания, полученные на больших и разнообразных наборах данных. Использование этих моделей позволяет извлечь полезные признаки из данных, которые можно далее использовать для решения широкого спектра задач в различных областях.

- Обобщаемость и универсальность: Предтренированные модели обладают высокой обобщающей способностью и могут успешно работать с данными, которые отличаются от данных, на которых они были обучены. Это позволяет использовать такие модели для разных задач и в разных сферах - от компьютерного зрения и обработки естественного языка до анализа данных и решения других задач машинного обучения.

- Улучшение качества и точности: Зачастую предтренированные модели обладают высокой точностью и качеством, благодаря многократному обучению на больших объемах данных. Использование таких моделей может значительно повысить точность и надежность решений, основанных на машинном обучении, и снизить риск ошибок, связанных с непредсказуемым поведением модели.

- Быстрая реализация и интеграция: Предтренированные модели часто предоставляются в виде готовых, легко загружаемых пакетов или библиотек, что упрощает их использование и интеграцию в существующие системы и проекты. Это позволяет быстро разрабатывать и внедрять решения на основе машинного обучения, сокращая время построения модели и ускоряя время приносящую прибыль.

Таким образом, использование предтренированных моделей является эффективным и выгодным подходом в машинном обучении, позволяющим сократить затраты на обучение, захватить доменные знания и повысить качество и точность разрабатываемых решений.

Методы обучения и настройки моделей в машинном обучении

Один из наиболее распространенных методов обучения – это метод обучения с учителем. В этом случае модель обучается на основе данных, в которых для каждого примера уже известен правильный ответ. Модель настраивается таким образом, чтобы минимизировать разницу между предсказанными значениями и правильными ответами. Этот метод обеспечивает хорошую точность предсказания, но требует обширного набора помеченных данных для обучения.

Другой метод обучения – это метод обучения без учителя, который применяется, когда правильные ответы неизвестны. Вместо этого модель ищет в данных закономерности и шаблоны, чтобы сгруппировать или иным образом организовать данные. Этот метод может использоваться для задач кластеризации или снижения размерности данных.

Еще одним методом обучения является метод обучения с подкреплением. В этом случае модель обучается на основе последовательности действий и наград. Она получает награду или штраф в зависимости от того, насколько успешно она выполнила задачу. Модель настраивается таким образом, чтобы максимизировать суммарную награду. Этот метод часто используется для решения задач обучения взаимодействию с окружающей средой, например, в области робототехники или управления автономными системами.

Для настройки моделей в машинном обучении также используются различные методы, например, метод градиентного спуска. Этот метод основан на поиске минимума или максимума функции путем изменения параметров модели в направлении, противоположном градиенту функции. Он позволяет найти оптимальные значения параметров модели, минимизирующие ошибку или максимизирующие качество предсказания.

Еще одним методом настройки моделей является метод регуляризации, который используется для предотвращения переобучения модели. При регуляризации модель штрафуется за слишком сложные искомые функции или за использование большого количества параметров. Это позволяет создать более устойчивую модель, которая будет хорошо обобщать данные и давать хорошие результаты на новых примерах.

В итоге, выбор метода обучения и настройки моделей зависит от поставленной задачи, доступных данных и требований к производительности модели. Комбинирование различных методов и их настройка может привести к созданию оптимальной модели, способной эффективно решать конкретную задачу.