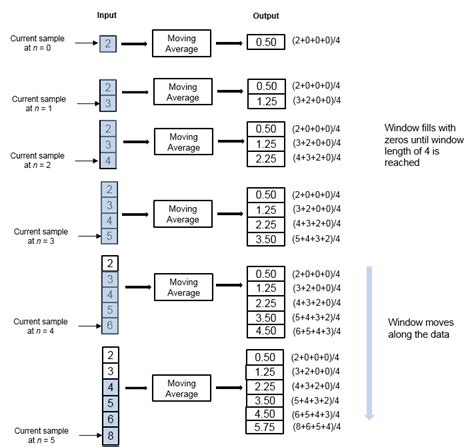

Анализ данных является важной задачей во многих областях, таких как финансы, медицина и прогнозирование погоды. Нейронные сети со скользящим окном являются одним из наиболее эффективных инструментов для анализа временных рядов данных. Суть использования скользящего окна заключается в том, что на каждом шаге окно смещается на одну позицию и используются только данные из окна для обучения нейронной сети.

Однако, настройка нейронной сети со скользящим окном может быть сложной задачей. Как определить оптимальный размер окна? Каким образом выбрать наилучшие параметры нейронной сети? В данной статье будут рассмотрены эффективные методы и техники для настройки нейронной сети со скользящим окном.

Во-первых, для настройки нейронной сети со скользящим окном необходимо определить оптимальный размер окна. Слишком маленькое окно может привести к потере важной информации, а слишком большое окно может привести к переобучению модели. Для определения оптимального размера окна можно использовать кросс-валидацию или валидационный набор данных.

Во-вторых, при настройке нейронной сети со скользящим окном необходимо определить наилучшие параметры модели. Это включает выбор количества нейронов в скрытом слое, функции активации и коэффициента обучения. Для определения наилучших параметров можно использовать методы оптимизации, такие как генетические алгоритмы или методы градиентного спуска.

Определение эффективных методов и техник

Первым методом является оптимальный выбор параметров окна. Размер окна должен быть достаточно большим для того, чтобы включить в рассмотрение достаточное количество исторических данных, но при этом не слишком большим, чтобы не увеличивать избыточность и сложность модели. Важно провести эксперименты с различными размерами окна и определить оптимальное значение.

Вторым методом является использование различных алгоритмов оптимизации. Нейронная сеть со скользящим окном обычно требует большого количества итераций для обучения, поэтому выбор эффективного алгоритма оптимизации может значительно сократить время обучения и повысить качество модели. Некоторые популярные алгоритмы оптимизации включают градиентный спуск, стохастический градиентный спуск и адам.

Третьим методом является использование регуляризации. Негативное влияние переобучения может быть существенно сокращено путем применения техник регуляризации, таких как L1 и L2 регуляризация. Дополнительное штрафование за большие значения весов модели способствует более устойчивому обучению и более обобщающим предсказаниям.

Четвертым методом является использование ансамблей моделей. Комбинирование нескольких нейронных сетей со скользящим окном может привести к лучшим результатам, чем использование одной модели. Этот подход может быть реализован путем среднего или голосования по прогнозам разных моделей, что увеличивает устойчивость прогнозов и снижает риск ошибок.

Необходимость настройки нейронной сети для анализа данных

Однако, для эффективного использования нейронных сетей необходимо правильно настроить их параметры, особенно при анализе данных с использованием скользящего окна. Скользящее окно является основным методом для анализа временных рядов, сигналов и изображений, позволяющим выделить локальные аномалии и тренды.

При настройке нейронной сети со скользящим окном необходимо учитывать несколько важных факторов. Во-первых, необходимо выбрать оптимальный размер окна, который позволит достаточно подробно анализировать данные, не утратив важную информацию. Во-вторых, следует учесть возможность перекрытия окон для более точного анализа. В-третьих, важным фактором является выбор подходящей архитектуры нейронной сети и оптимизации ее параметров, таких как количество слоев и нейронов, функции активации и параметры обучения.

Для эффективной настройки нейронной сети со скользящим окном рекомендуется использовать методы кросс-валидации и проверку модели на отложенных данных. Кросс-валидация позволяет оценить качество модели на разных частях данных и выбрать оптимальные параметры. Проверка модели на отложенных данных позволяет оценить ее производительность на новых данных и проверить ее способность обобщать решения.

| Преимущества настройки нейронной сети для анализа данных | Методы настройки нейронной сети для анализа данных |

|---|---|

| 1. Улучшение точности предсказаний и анализа данных. | 1. Кросс-валидация. |

| 2. Увеличение надежности результатов анализа. | 2. Проверка модели на отложенных данных. |

| 3. Оптимизация использования вычислительных ресурсов. | 3. Подбор оптимальной архитектуры и параметров сети. |

Роль скользящего окна в процессе анализа данных

Основной принцип работы скользящего окна заключается в том, что оно перемещается по последовательности данных с определенным шагом и выполняет анализ на каждом сегменте. Такой подход позволяет детектировать и изучать локальные паттерны и структуру данных. Каждое окно может служить входным набором данных для нейронной сети, что позволяет ей обобщать обнаруженные закономерности на весь набор данных.

Для обнаружения временных зависимостей в данных можно использовать различные методы и техники настройки скользящего окна. Например, можно определить оптимальную ширину и шаг скользящего окна с помощью кросс-валидации или автоматического подбора параметров. Также можно изменять форму окна, добавлять разные веса для разных частей данных, чтобы отразить их важность для анализа.

Преимуществом скользящего окна является его способность адаптироваться к различным типам данных и задач анализа. Он может использоваться в области медицины для анализа временных рядов пациентов, в финансовой сфере для прогнозирования временных рядов цен на акции, или в машинном зрении для анализа видео.

Использование методов машинного обучения для настройки нейронной сети

1. Алгоритм обратного распространения ошибки

Алгоритм обратного распространения ошибки является одним из наиболее распространенных методов настройки нейронных сетей. Он основывается на минимизации ошибки между ожидаемыми и предсказанными значениями. В процессе обучения, алгоритм вычисляет градиент ошибки по весам нейронной сети и аккумулирует изменения весов на каждой итерации. Таким образом, алгоритм обратного распространения ошибки позволяет обучать нейронную сеть со скользящим окном для анализа временных рядов.

2. Генетические алгоритмы

Генетические алгоритмы - это поиск и оптимизация, основанные на принципах естественного отбора и генетики. Они могут использоваться для настройки нейронных сетей со скользящим окном путем эволюционного преобразования весов. Генетические алгоритмы оперируют с популяцией решений и применяют операторы скрещивания, мутации и отбора, чтобы найти оптимальные значения весов. Этот подход может быть полезен в случаях, когда применение алгоритма обратного распространения ошибки затруднено или неэффективно.

3. Алгоритмы окна Хамминга

Алгоритмы окна Хамминга предназначены для управления весами нейронной сети в зависимости от времени. Они применяются для создания подвижных окон, которые позволяют нейронной сети акцентировать внимание на определенных участках данных. Алгоритмы окна Хамминга могут использоваться совместно с алгоритмом обратного распространения ошибки для эффективной настройки нейронной сети со скользящим окном.

4. Алгоритмы кластеризации

Алгоритмы кластеризации могут быть использованы для настройки нейронной сети со скользящим окном путем разбиения данных на группы (кластеры) схожих образцов. Каждый кластер может иметь свои собственные веса нейронной сети, что позволяет моделировать различные характеристики данных. Этот подход может быть полезен при анализе больших объемов данных, где применение традиционных методов настройки нейронной сети становится затруднено.

Таблица сравнения методов и техник

| Метод/Техника | Описание |

| Алгоритм обратного распространения ошибки | Минимизация ошибки между ожидаемыми и предсказанными значениями |

| Генетические алгоритмы | Эволюционное преобразование весов на основе принципов естественного отбора и генетики |

| Алгоритмы окна Хамминга | Управление весами нейронной сети в зависимости от времени |

| Алгоритмы кластеризации | Разбиение данных на группы схожих образцов для моделирования различных характеристик данных |

Применение техник оптимизации для повышения эффективности настройки

Техники оптимизации позволяют найти оптимальные значения параметров нейронной сети, чтобы достичь наилучшей производительности. Они используются для улучшения качества предсказаний и повышения точности модели.

Одной из популярных техник оптимизации является градиентный спуск. Он основан на вычислении градиента функции потерь и последующем обновлении параметров сети в направлении наискорейшего убывания функции потерь. Градиентный спуск позволяет достичь оптимальных значений параметров и улучшить обучение сети.

Еще одной важной техникой оптимизации является стохастический градиентный спуск. Он отличается от классического градиентного спуска тем, что обновление параметров происходит не после вычисления градиента на всей выборке, а после каждого образца из обучающего набора данных. Такой подход позволяет получить более быструю сходимость и улучшить процесс настройки сети.

Другой эффективной техникой оптимизации является адаптивный градиентный спуск. Он изменяет скорость обучения для каждого параметра сети, учитывая их важность. Это позволяет более эффективно настраивать сеть, не задерживаясь на медленно обучающихся параметрах и уделяя больше внимания более важным.

Кроме того, существует множество других техник оптимизации, таких как методы оптимизации на основе момента, адама и другие. Каждая из этих техник имеет свои особенности и может быть применена в зависимости от конкретной задачи и требований.

| Техника оптимизации | Преимущества |

|---|---|

| Градиентный спуск | Находит глобальный минимум функции потерь |

| Стохастический градиентный спуск | Улучшает скорость сходимости |

| Адаптивный градиентный спуск | Улучшает эффективность настройки параметров |

Оценка результатов и выбор наиболее эффективных методов

После настройки нейронной сети со скользящим окном для анализа данных необходимо оценить полученные результаты и выбрать наиболее эффективные методы. Для этого можно воспользоваться следующими подходами:

1. Кросс-валидация: разбить исходные данные на обучающую и тестовую выборки и провести несколько итераций обучения и тестирования. На основе полученных результатов можно оценить эффективность разных комбинаций параметров и выбрать лучшую.

2. Метрики оценки результатов: применять различные метрики, такие как точность, полнота, F-мера и площадь под ROC-кривой (AUC-ROC), для оценки качества модели. Предпочтительным вариантом может быть выбор модели с наивысшей точностью или AUC-ROC.

3. Сравнение с базовыми моделями: рекомендуется сравнивать результаты, полученные с использованием нейронной сети со скользящим окном, с результатами базовых моделей или других традиционных методов анализа данных. Если нейронная сеть показывает значительное улучшение по сравнению с базовыми моделями, то можно считать её эффективной.

4. Учет времени обучения и предсказания: при выборе наиболее эффективного метода также необходимо учитывать время, затраченное на обучение модели и время, затраченное на предсказания. Желательно выбрать метод, который достигает высокой эффективности, при этом имеет небольшое время обучения и предсказания.

Все перечисленные подходы могут быть использованы в комбинации для достижения наиболее эффективной настройки нейронной сети со скользящим окном в анализе данных. Учитывая полученные результаты и анализируя их, можно принять взвешенное решение и выбрать оптимальный метод.