Объем сэмпла является одним из важных аспектов, которые нужно учитывать при проведении исследования. Чем больше наблюдений в выборке, тем более достоверными оказываются полученные результаты. Но что делать, если у вас есть ограниченный объем собранной информации? В данной статье мы рассмотрим 6 эффективных методов для расширения выборки, которые помогут вам повысить достоверность ваших исследований.

Первый способ - это использование вторичных данных. В некоторых случаях может оказаться полезным использовать уже существующие базы данных или исследования, которые были проведены ранее другими исследователями. Такой подход позволяет значительно увеличить объем сэмпла и получить дополнительные данные для анализа.

Второй способ - это расширение географического охвата выборки. Если ваша выборка ограничена определенной территорией, попробуйте включить в нее данные из других регионов. Это позволит получить более полную картину и расширить область применимости полученных результатов.

Третий способ - это увеличение объема выборки путем увеличения длительности наблюдений. Если у вас есть возможность продлить время исследования или собрать данные за более длительный период времени, это может значительно увеличить объем сэмпла и повысить достоверность полученных результатов.

Четвертый способ - это использование методов случайной выборки. При случайной выборке каждый элемент попадает в выборку с равной вероятностью, что позволяет получить репрезентативную выборку и увеличить ее объем без смещения результатов.

Пятый способ - это проведение более широкого анкетирования или опроса. Если у вас есть возможность задать большее количество вопросов респондентам или провести опрос в более разнообразной группе людей, это поможет увеличить объем сэмпла и получить больше данных для дальнейшего анализа.

И, наконец, шестой способ - это проведение дополнительных исследований. Если ваша первоначальная выборка была ограничена, попробуйте провести дополнительные исследования, чтобы получить больше данных. Например, можно провести серию фокус-групп или глубинных интервью с целью получить дополнительную информацию для анализа и расширить объем сэмпла.

Итак, вы знаете 6 способов увеличить объем сэмпла и расширить выборку. Каждый из этих методов имеет свои особенности и может быть применим в разных ситуациях. Выберите те методы, которые наиболее подходят вашему исследованию, и повысьте достоверность полученных результатов.

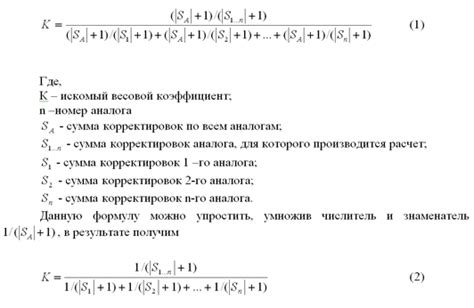

Использование весовых коэффициентов

Для применения весовых коэффициентов необходимо оценить значимость каждого примера. Это может быть основано на экспертных знаниях, статистическом анализе или других методах. Значимость примера определяется числом от 0 до 1, где 0 – не значимый пример, 1 – наиболее значимый пример.

Применение весовых коэффициентов заключается в умножении каждого примера на его весовой коэффициент при обучении модели. Таким образом, примеры с большими весами будут иметь большее влияние на обучение, а примеры с меньшими весами – меньшее влияние.

Весовые коэффициенты могут быть заданы вручную или использованы в результате анализа данных. Важно подобрать правильные весовые коэффициенты, чтобы учесть все факторы, влияющие на значимость примера.

Использование весовых коэффициентов может помочь увеличить разнообразие данных в обучающей выборке и снизить переобучение модели. Весовые коэффициенты позволяют акцентировать внимание на примерах, которые часто ошибочно классифицируются моделью или имеют большую значимость для конкретной задачи.

Увеличение веса редких классов

Подмена дисбаланса классов онлайн-гамма-коррекцией – один из методов увеличения веса редких классов. Она заключается в том, чтобы варьировать веса ошибок, которые происходят на положительных и отрицательных классах, чтобы компенсировать дисбаланс в выборке. Например, можно установить вес ошибки умноженной на коэффициент. Если коэффициент больше единицы, то вес ошибки положительного класса будет увеличен, и это позволит учесть большее количество наблюдений этого класса.

Другим способом увеличить вес редких классов является генерация синтетических примеров. Один из популярных алгоритмов для выполнения этой задачи - SMOTE (Synthetic Minority Over-sampling Technique). Суть алгоритма заключается в создании новых синтетических образцов, основанных на анализе ближайших соседей существующих сэмплов. Это позволяет увеличить представительность редкого класса и улучшить обобщающую способность модели.

Хотя увеличение веса редких классов является полезным инструментом для повышения качества классификации, следует помнить, что его применение может привести к переобучению модели и недооценке работы на обычных ситуациях. Поэтому важно аккуратно балансировать выборку и применять сочетание различных методов для достижения наилучших результатов.

| Преимущества | Недостатки |

|---|---|

| Повышение представительности редких классов | Потенциальное переобучение модели |

| Улучшение обобщающей способности модели | Недооценка работы на обычных ситуациях |

| Компенсация дисбаланса классов | |

Уменьшение веса часто встречающихся классов

Когда мы работаем с набором данных, иногда можем столкнуться с ситуацией, когда какие-то классы представлены значительно чаще, чем остальные. Это может негативно повлиять на качество модели, так как алгоритм будет склонен к предсказаниям наиболее частого класса.

Одним из способов решить эту проблему является уменьшение веса часто встречающихся классов. Мы можем сделать это путем искусственного увеличения данных редких классов или сокращения данных частых классов.

Для увеличения данных редких классов мы можем использовать методы аугментации данных, такие как поворот, сдвиг, изменение размера и применение фильтров. Это позволит нам создать новые образцы данных для редких классов и сделать их более представительными в обучающей выборке.

С другой стороны, для сокращения данных частых классов мы можем случайным образом удалить некоторые образцы или использовать алгоритмы сэмплирования, такие как undersampling или применение взвешивания классов. Это снизит вес частых классов в процессе обучения и позволит модели лучше справиться с редкими классами.

Важно учитывать, что при уменьшении веса частых классов необходимо быть осторожными, чтобы не потерять информацию и сохранить баланс между классами. Поэтому рекомендуется провести некоторые эксперименты и выбрать оптимальный подход на основе результатов.

| Метод | Описание |

|---|---|

| Аугментация данных | Создание новых образцов данных редких классов путем искусственного изменения существующих данных |

| Удаление данных | Случайное удаление некоторых образцов данных частых классов для снижения их веса |

| Undersampling | Выбор случайного подмножества образцов данных частых классов для создания сбалансированной выборки |

| Взвешивание классов | Присвоение различных весов разным классам для корректировки их влияния на процесс обучения |

Генерация синтетических данных

Генерация синтетических данных представляет собой один из эффективных способов увеличить объем сэмпла. Этот метод заключается в создании новых данных на основе имеющихся, используя различные алгоритмы и моделирование.

Одним из подходов к генерации синтетических данных является использование алгоритма GAN (генеративно-состязательные сети). GAN позволяет создавать новые данные на основе имеющихся, с помощью двух нейронных сетей - генератора и дискриминатора. Генератор создает новые данные, а дискриминатор оценивает их реалистичность. Путем обучения этих двух сетей, мы можем получить синтетические данные, которые могут быть использованы для расширения выборки.

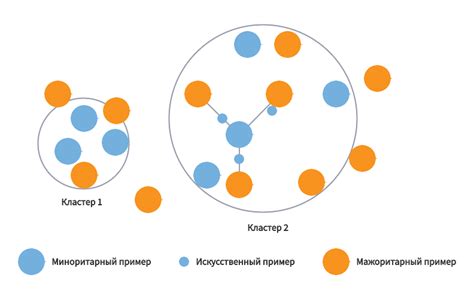

Еще одним методом генерации синтетических данных является использование алгоритма SMOTE (Synthetic Minority Over-sampling Technique). SMOTE позволяет создавать новые примеры миноритарного класса на основе имеющихся данных, путем генерации синтетических "соседей" для каждого примера миноритарного класса. Этот метод позволяет уравновесить классы и увеличить объем сэмпла миноритарного класса.

Еще одним подходом к генерации синтетических данных является использование алгоритма аугментации данных, который заключается в добавлении различных модификаций к существующим примерам данных, таких как повороты, масштабирование, шум и т. д. Это позволяет создать разнообразные варианты существующих примеров и увеличить объем сэмпла.

Однако, при использовании генерации синтетических данных, необходимо учитывать их качество и реалистичность. Для этого важно обучить модель на "реальных" данных и тщательно проверить сгенерированные данные перед использованием их в моделировании или обучении модели.

Генерация синтетических данных является эффективным методом для увеличения объема сэмпла. Этот метод позволяет создавать новые данные на основе имеющихся, используя различные алгоритмы и моделирование. При использовании генерации синтетических данных, необходимо учитывать их качество и реалистичность.

Использование алгоритма SMOTE

SMOTE работает следующим образом. Он выбирает случайный экземпляр минорного класса и находит k ближайших соседей этого экземпляра (k - параметр, обычно устанавливается в 5). Затем алгоритм выбирает случайного соседа из k ближайших и создает новый синтетический экземпляр, добавляя случайное значение отношения между выбранным экземпляром и выбранным соседом. Этот процесс повторяется для всех экземпляров минорного класса до достижения желаемого объема сэмпла.

Основное преимущество алгоритма SMOTE заключается в том, что он способен создавать разнообразные синтетические экземпляры, что помогает избежать переполнения и улучшает обобщающую способность модели. Благодаря генерации новых примеров, SMOTE позволяет сбалансировать классы в выборке и сделать обучающую выборку более репрезентативной для обоих классов.

Однако, стоит отметить, что использование алгоритма SMOTE может привести к некоторым проблемам. Например, если количество синтетических экземпляров будет слишком большим, это может привести к переобучению модели. Кроме того, SMOTE не учитывает информацию о распределении признаков, что может быть проблемой в случае, если они имеют неоднородное распределение.

В целом, алгоритм SMOTE является полезным инструментом для расширения выборки и балансировки классов в задачах машинного обучения. Однако, его использование требует осторожности и анализа результатов, чтобы избежать нежелательных эффектов и достичь более точных моделей.

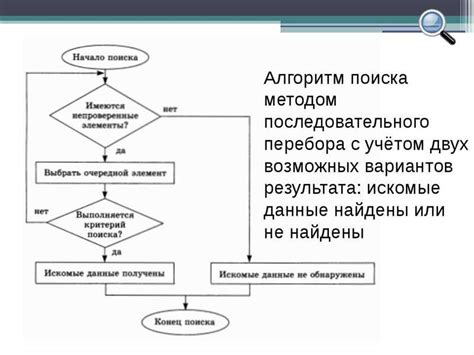

Применение алгоритма аугментации

Алгоритм аугментации применяется к исходной выборке данных с целью создания новых примеров для обучения модели. Этот алгоритм может включать различные операции, такие как поворот, изменение размера, сдвиг, добавление шума и другие.

Применение алгоритма аугментации позволяет увеличить объем данных, что может быть полезно в ситуациях, когда исходная выборка данных недостаточна для эффективной обучения модели. Выбор подходящего алгоритма аугментации зависит от конкретной задачи и типа данных.

Преимущества применения алгоритма аугментации включают:

- Улучшение обобщающей способности модели: создание новых примеров позволяет модели обучаться на более разнообразных данных, что может улучшить ее способность к обобщению.

- Снижение переобучения: увеличение объема данных может снизить риск переобучения модели, когда модель слишком точно подстраивается под обучающую выборку.

- Увеличение разнообразия данных: аугментация данных позволяет добавить разнообразие в обучающую выборку, что может быть полезно в случаях, когда исходные данные слишком схожи между собой.

- Создание устойчивости к искажениям: применение алгоритма аугментации позволяет модели обучаться на значительно более широком диапазоне данных, что делает ее более устойчивой к искажениям, таким как шум, изменения освещения и т. д.

Применение алгоритма аугментации является эффективным методом для расширения выборки данных и улучшения качества обучения модели. Этот подход особенно полезен в случаях, когда доступных данных недостаточно или когда исходные данные имеют ограниченное разнообразие.

Сбор дополнительных данных

Для увеличения объема сэмпла можно использовать метод сбора дополнительных данных. Этот подход позволяет получить больше информации о выборке и расширить ее.

Вот несколько способов собрать дополнительные данные:

- Проведение дополнительных экспериментов. Вы можете провести дополнительные эксперименты, чтобы расширить вашу выборку данных. Например, если вы анализируете поведение пользователей на вашем сайте, вы можете проводить дополнительные тесты, чтобы собрать больше данных о их взаимодействии с сайтом.

- Использование открытых баз данных. Существует множество открытых баз данных, которые вы можете использовать для сбора дополнительных данных. Например, если вам нужны данные о климате, вы можете использовать открытые базы данных о погоде.

- Сбор данных с помощью онлайн-опросов. Онлайн-опросы - это отличный способ собрать дополнительные данные от вашей целевой аудитории. Вы можете создать опросы на различных платформах и пригласить людей заполнить их.

- Анализ открытых источников. Вы можете использовать открытые источники информации, такие как новости, социальные сети, форумы и блоги, чтобы получить дополнительные данные. Это может быть полезно, например, при анализе общественного мнения по определенной теме.

- Проведение дополнительных исследований. Вы можете провести дополнительные исследования, чтобы собрать больше данных о вашей выборке. Например, вы можете провести интервью, наблюдения или анализ документов.

- Организация партнерских программ. Вы можете установить партнерские отношения с другими организациями или компаниями, чтобы получить доступ к их данным. Например, если вы занимаетесь анализом продаж, вы можете установить партнерство с компаниями, чтобы получить доступ к их данных о продажах.

Сбор дополнительных данных может быть трудоемким процессом, но он позволяет получить больше информации о выборке и улучшить результаты анализа.